Kekeliruan Fatal AI Keamanan Sekolah: Kantong Doritos Disangka Senjata Api, Siswa Digeledah!

Kekeliruan Fatal AI Keamanan Sekolah: Kantong Doritos Disangka Senjata Api, Siswa Digeledah!

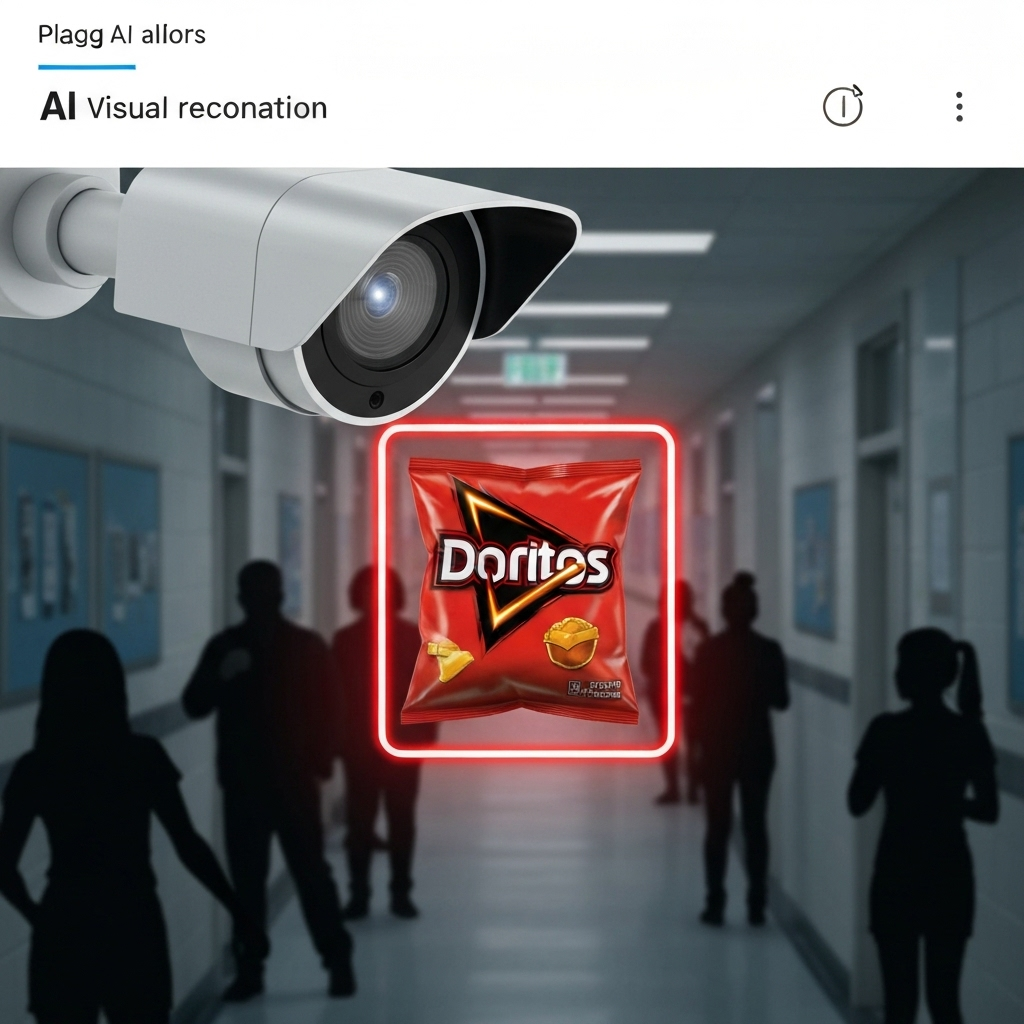

DIGITALUPDATE.ID – Kecerdasan buatan (AI) terus diintegrasikan ke dalam berbagai aspek kehidupan, termasuk sistem keamanan. Namun, insiden mengejutkan baru-baru ini di sebuah sekolah menengah atas menyoroti potensi kelemahan dan kekeliruan fatal yang bisa ditimbulkan oleh teknologi ini. Seorang siswa digeledah dan diborgol setelah sistem keamanan AI sekolah salah mendeteksi sekantong keripik Doritos sebagai senjata api.

Insiden yang Menggemparkan di Kenwood High School

Kasus ini terjadi di Kenwood High School, Baltimore County, Maryland, Amerika Serikat. Seorang siswa bernama Taki Allen mengalami pengalaman traumatis ketika sistem keamanan berbasis AI yang digunakan sekolah, Omnilert, memberikan peringatan bahaya. Menurut laporan, sistem tersebut keliru mengidentifikasi sekantong keripik Doritos yang dibawa Taki sebagai potensi senjata api.

Akibatnya, petugas keamanan sekolah segera bertindak, memborgol dan menggeledah siswa tersebut. Insiden ini, yang seharusnya menjadi upaya untuk meningkatkan keamanan, justru menimbulkan ketidaknyamanan dan pertanyaan serius tentang keandalan AI dalam skenario dunia nyata.

Tantangan Akurasi dan Keandalan Sistem Keamanan AI

Penerapan AI dalam sistem keamanan sekolah bertujuan untuk mendeteksi ancaman secara cepat dan mencegah insiden kekerasan. Sistem seperti Omnilert dirancang untuk memindai rekaman kamera dan mengidentifikasi objek atau perilaku mencurigakan yang dapat mengindikasikan bahaya. Namun, kasus Taki Allen menunjukkan celah signifikan dalam akurasi AI saat menghadapi objek yang tidak jelas atau konteks yang ambigu.

Beberapa poin penting terkait tantangan akurasi AI:

- False Positives (Deteksi Palsu): Insiden ini adalah contoh klasik dari "false positive," di mana sistem mengidentifikasi ancaman yang sebenarnya tidak ada. Ini dapat menyebabkan kepanikan yang tidak perlu dan penanganan yang salah terhadap individu yang tidak bersalah.

- Konteks dan Ambiguitas: AI kesulitan memahami konteks sepenuhnya. Bagi manusia, sekantong Doritos jelas bukan senjata. Namun, bagi algoritma yang dilatih dengan data terbatas, bentuk atau refleksi tertentu bisa saja memicu alarm.

- Keterbatasan Data Pelatihan: Kualitas dan keragaman data yang digunakan untuk melatih AI sangat menentukan kemampuannya. Jika AI tidak dilatih dengan skenario yang cukup luas, ia mungkin rentan terhadap kesalahan dalam kondisi yang tidak terduga.

Dampak Psikologis dan Pertanyaan Privasi

Bagi Taki Allen, insiden ini bukan hanya sekadar kesalahan teknis. Diborgol dan digeledah di lingkungan sekolah dapat meninggalkan trauma dan rasa tidak percaya terhadap sistem dan otoritas. Hal ini juga memicu diskusi lebih luas mengenai privasi dan hak-hak siswa di sekolah yang menggunakan teknologi pengawasan canggih.

- Pelanggaran Privasi: Penggunaan AI untuk pengawasan massal menimbulkan kekhawatiran tentang sejauh mana data siswa dikumpulkan, dianalisis, dan disimpan.

- Erosi Kepercayaan: Insiden seperti ini dapat merusak kepercayaan siswa, orang tua, dan staf terhadap teknologi keamanan dan terhadap administrasi sekolah yang mengandalkannya.

- Stres dan Kecemasan: Lingkungan yang selalu diawasi oleh AI yang rentan kesalahan dapat menciptakan suasana stres dan kecemasan di kalangan siswa.

Pembelajaran dan Langkah ke Depan

Kasus di Kenwood High School harus menjadi peringatan penting bagi institusi pendidikan dan pengembang teknologi. Untuk memaksimalkan manfaat AI dalam keamanan sambil meminimalkan risikonya, langkah-langkah berikut perlu dipertimbangkan:

- Pengawasan Manusia: AI harus selalu berfungsi sebagai alat pendukung, bukan pengganti penilaian dan intervensi manusia. Protokol yang jelas harus menetapkan kapan dan bagaimana manusia harus memverifikasi peringatan AI.

- Pelatihan AI yang Lebih Baik: Pengembang perlu berinvestasi lebih banyak dalam melatih model AI dengan kumpulan data yang lebih luas dan konteks yang lebih spesifik untuk lingkungan sekolah.

- Transparansi dan Akuntabilitas: Sekolah harus transparan tentang penggunaan sistem AI mereka dan memiliki mekanisme akuntabilitas yang jelas untuk menangani kesalahan atau pelanggaran.

- Kebijakan yang Jelas: Membangun kebijakan yang kuat tentang privasi data, penggunaan data, dan prosedur tanggap darurat ketika AI memberikan peringatan adalah krusial.

Insiden di Kenwood High School adalah pengingat bahwa meskipun AI menawarkan potensi besar untuk meningkatkan keamanan, ia tidak sempurna. Penting untuk mendekati implementasinya dengan hati-hati, memastikan akurasi, menjaga privasi, dan selalu menempatkan kesejahteraan serta hak-hak individu di atas teknologi. Tanpa keseimbangan yang tepat, sistem yang dirancang untuk melindungi justru dapat menjadi sumber kekhawatiran baru.